分布式缓存的一起问题

背景说明

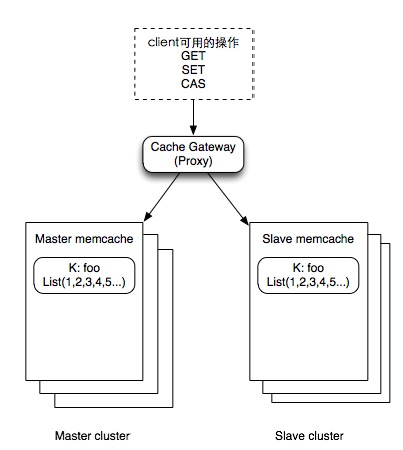

分布式缓存中为了可用性及高性能的考虑,可以使用如下一种master/slave设计模式。

图中的proxy是逻辑的概念,可以是基于client的包装实现,也可以是独立的proxy服务,但本文大部分是指独立的服务。几个主要的问题说明如下。

为什么cache要使用两个集群((master/slave)来存放?

主要出于可用性及高性能的考虑。传统的架构使用基于一致性哈希的分布式缓存,数据只存在一份副本,在出现cache节点单点故障时,虽然可以由一致性哈希算法将请求均匀落到其他节点,但由于穿透的请求较多,仍然给数据库带来较大的访问压力。为了避免对数据穿透带来的冲击,数据使用两份副本可以避免穿透的问题。同时在数据访问较大时候,也可以更好的分担流量,避免峰值单份数据跑满对系统带来的冲击。

为什么两份副本要使用master/slave结构?

由于大型系统中通常存在多个client同时操作同一份数据,需要确保所有client对数据修改时数据的一致性。为了避免两cluster两份副本数据不一致带来的困扰,使用了一个简单的做法,在配置中人为指定一个cluster为master,所有的数据以master为准。

为什么一些场景需要使用CAS?

CAS在计算机并发领域通常指Compare-and-swap,在memcached中,也称为Check And Set. 在分布式系统中,一份数据可能同时被多个调用修改,比如微博中的@箱,一个用户同时收到多个@的情况还是比较常见,比如当原来@箱里面记录是{1,2,3}时,4和5由不同的调用来源同时到达,如果没有同步的保护,系统的数据有可能最终被写成{1,2,3,4}或{1,2,3,5},由于memcached没有原生的list结构,list都是一个自定义的value, 则很容易出现client A覆盖了同时在写的client B的数据。因此假如两个调用方同时读到{1,2,3}时,第一个写入{1,2,3,4}会成功,后续的{1,2,3,5}CAS写入就会失败,因为此时服务器已经不是{1,2,3}了,失败的调用向服务端取回{1,2,3,4},最终写入{1,2,3,4,5}

在master/slave场景,比起普通的memcache CAS有什么区别?

目前的做法是master cas成功之后,直接修改slave,并不同时在slave执行cas操作。由于数据存在两份副本,当数据不一致时,无法自动处理数据的不一致冲突。因此在实践上只以master操作为准。

为什么使用proxy?

使用proxy主要是出于可用性、命中率以及可运维方面的考虑

可用性与可运维:当进行服务器增容或缩容时,如果client的数量较大,如果未使用proxy模式,client所在服务器通常需要修改配置并且逐个重启。重启(系统维护)一方面带来可用性方面的问题,运维方面也较为繁琐。

命中率:如果业务场景需要较高的命中率(比如>90%),则增容或缩容就变得较为复杂,需要client配合做一些策略,比如扩容后仍然访问扩容前旧的节点的数据以保证命中率。如果用proxy模式则极大降低client的访问复杂性,将相关逻辑都封装在proxy之后。

分布式缓存的一起问题

最近某业务有一起master单点故障,导致在问题的时间段内,用户看不到最近发生变更的数据。由于在上述场景中,实现cas时候的流程如下

1) master.cas(k,v)

2) 如果1成功,slave.set(k,v)

3) 如果1失败,不执行slave.set(),直接return;

由于第三步在失败时,并不会set slave,导致数据出现一致性问题,即使slave依然可用,新的数据不会写入cache。

首先看在master failure时,为什么不切换到slave cas?

先说自动切换的问题

上文也提过,两份数据副本在出现数据不一致后,并不能自动仲裁达到最终一致性,但是指定master角色可以达到最终一致性。如果master角色可以由调用方自动切换,则会带来数据的混乱。调用方存在多个节点,至少需要统一的config server来保证切换的一致性。另外,自动切换发生后,无法达到两份数据的最终一致性。

再说由运维手工切换

由于不牵涉到代码的逻辑判断,虽然切换也会带来一些数据一致性问题,在具体场景下(比如master长久宕机)切换可以接受。

在出现上述问题后,其他一些解决方案如下。

1. proxy在master cas失败时候delete slave data

2. client在master cas失败时set slave, 并且将数据过期时间设成5分钟

上述方案很难完美,一些明显存在的问题如下

方案1:

命中率的问题。由于delete导致修改的数据迅速失效,会导致读取量的增加,在读写均密集的业务场景,可能会导致数据访问出现波动。

接口职责单一性的问题。proxy在cas调用中隐藏了删除数据的逻辑,这是一个未在正常期望范围内的额外操作,在特殊情况下,可能会导致不可预料的情况出现。(尽管在实际操作中proxy提供配置开关选项)

方案2:

依然是命中率的问题,5分钟过期延缓了过期的访问数据库的压力,但相关压力仍然会传递到数据库。

希望通过上面说明读者能理解这个场景的问题。在这个场景下,完美的方案应当如何设计?

建议继续学习:

- 浅析http协议、cookies和session机制、浏览器缓存 (阅读:15467)

- 分布式缓存系统 Memcached 入门 (阅读:14422)

- Zookeeper工作原理 (阅读:10159)

- GFS, HDFS, Blob File System架构对比 (阅读:9214)

- 强制刷新本地 DNS 缓存记录 (阅读:9046)

- Zookeeper研究和应用 (阅读:8347)

- 分布式日志系统scribe使用手记 (阅读:7882)

- 一致性哈希算法及其在分布式系统中的应用 (阅读:7752)

- 分布式哈希和一致性哈希 (阅读:7441)

- HBase技术介绍 (阅读:6574)

扫一扫订阅我的微信号:IT技术博客大学习

- 作者:Tim 来源: Tim[后端技术]

- 标签: 分布式 缓存

- 发布时间:2014-11-23 20:57:53

-

[124] 招聘技巧一二

[124] 招聘技巧一二 -

[15] Linux常用系统信息查看命令

[15] Linux常用系统信息查看命令 -

[13] 最近总结的一些技巧(vim,python,s

[13] 最近总结的一些技巧(vim,python,s -

[12] 在FreeNAS/BSD搭建基于Nginx+

[12] 在FreeNAS/BSD搭建基于Nginx+ -

[12] Redis和Memcached的区别

[12] Redis和Memcached的区别 -

[11] 关于Linux的文件系统cache

[11] 关于Linux的文件系统cache -

[11] 个人开公司的流程,以后用得着

[11] 个人开公司的流程,以后用得着 -

[10] ps - 按进程消耗内存多少排序

[10] ps - 按进程消耗内存多少排序 -

[10] 我对技术方向的一些反思

[10] 我对技术方向的一些反思 -

[10] 每个程序员都应该知道的8个Linux命令

[10] 每个程序员都应该知道的8个Linux命令